Alors que beaucoup d’entre nous s’inquiétaient ces derniers jours de la suppression par notre président de « tout le monde », une entreprise technologique de la Silicon Valley a averti, sans trop en dire, que cela pourrait être un désastre. tous le monde tel que nous le connaissons.

La société technologique de San Francisco, Anthropic, a annoncé mardi Non en lançant une nouvelle version de son super-cerveau Claude AI – parce qu’il est trop puissant pour pirater n’importe quel système informatique, aussi sécurisé soit-il, en quelques jours et non en quelques heures.

“Les conséquences – pour les économies, la sécurité publique et la sécurité nationale – seraient dévastatrices”, a déclaré Anthropic dans un communiqué.

L’anxiété liée à l’IA n’a rien de nouveau. Nous nous inquiétons des activités, des jouets qui semblent trop réels à nos enfants, de la surveillance excessive de nos mouvements. Mais l’avertissement d’Anthropic concernant son propre produit va au-delà de ces problèmes spécifiques. Il y a eu un appel de l’intérieur de la maison indiquant que le désastre était imminent. Cela semble horrible et gonflé, je sais. Mais voici le problème : ce n’est pas le cas.

Anthropic, vous vous en souviendrez peut-être, est la société pour laquelle travaille le secrétaire américain à la Guerre, Pete Hegseth, parce qu’il ne voulait pas que Claude parte à la guerre sans surveillance et bombarde accidentellement des petites filles à l’école.

Ainsi, la société a émis cet avertissement alarmant : le Claude actuel qui a provoqué un tel brouhaha est ancien et moins puissant que le nouveau qui essaie de ne pas sortir – bien que ce nouveau Claude, appelé Claude Mythos Preview, ait déjà échappé plus d’une fois. Nous en parlerons davantage dans un instant : il n’y a qu’une quantité limitée de peur qu’une personne puisse gérer.

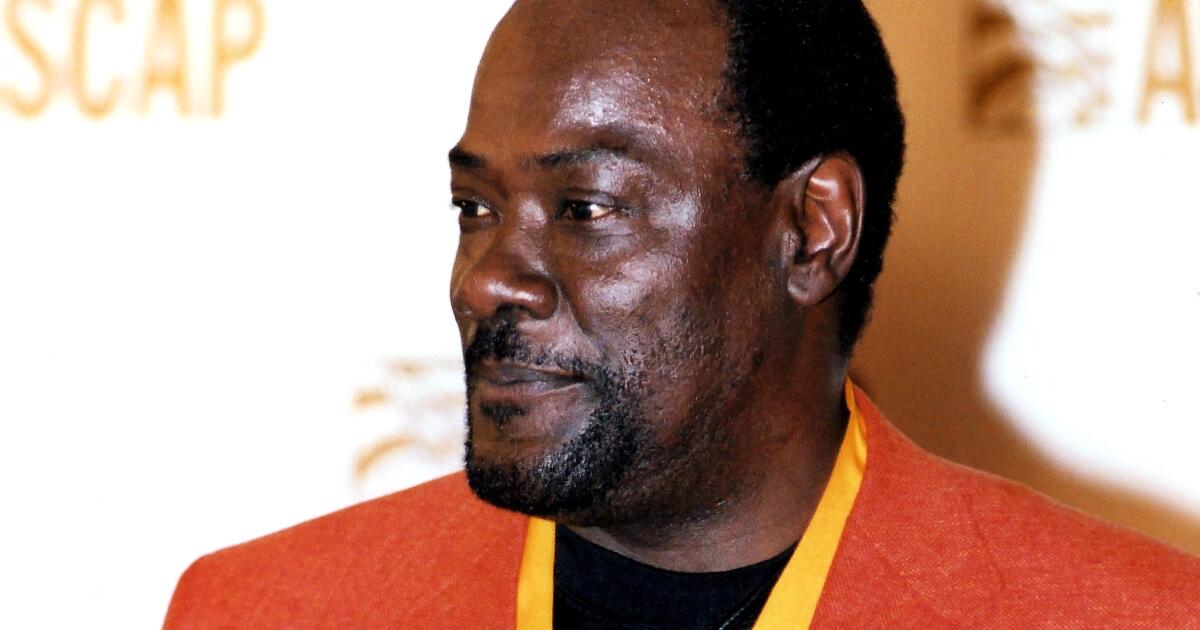

“Nous devrions tous nous inquiéter”, m’a dit Roman Yampolskiy à propos de cette avancée technologique si intelligente qu’elle change la façon de vivre des gens. Il est l’un des principaux chercheurs nationaux en matière de sécurité de l’IA et professeur à l’Université de Louisville dans le Kentucky.

“Nous sommes sur le point de créer une menace massive et de menacer la nation entière”, a déclaré Yampolskiy.

“Tout cela n’a aucune importance”, a-t-il ajouté, avant de conclure que j’étais fou de ne pas comprendre les aspects technologiques de ce débat. Mon explication simple, m’a-t-il dit, “est une manière raisonnable d’expliquer”.

Et voilà.

Il ne s’agit pas d’un scénario “cela peut être utilisé à mauvais escient par des informaticiens très avertis”, ni d’un scénario “rien du tout”, ni même d’un scénario “des enfants bombardent accidentellement”, c’est un scénario très effrayant.

Il “peut être utilisé par votre adolescent pour s’introduire dans le système scolaire local afin de modifier le signal avec très peu de connaissances et de briser accidentellement le système électrique de Californie”.

Peut-être qu’un pays qui ne nous aime pas – et j’en imagine certains – pourra vider les comptes bancaires des citoyens américains, tout en annonçant l’ouverture des verrous des voitures dans les prisons, la fermeture de nos stations d’épuration et la suppression des systèmes de climatisation. Peut-être que seul Claude Mythos fait ça.

Par exemple, Anthropic a déclaré que dans un système d’exploitation populaire testé et utilisé par des milliers d’entreprises, dont Netflix et Sony, Claude Mythos avait découvert une faille qui n’avait pas été vue depuis 17 ans. Puis, par lui-même – sans aide ni assistance humaine – il a compris comment utiliser cette faille pour gérer un serveur exécutant le système d’exploitation, à l’aide d’un ordinateur, n’importe où dans le monde.

Ce n’est qu’une plaisanterie, mais si un système de sécurité n’est pas sécurisé, les risques de problèmes sociaux, financiers et généraux sont infinis. Et pour être honnête, n’importe quel expert en sécurité vous dira que certains des domaines les plus faibles de l’Amérique en matière de cybersécurité sont les gouvernements locaux et étatiques, car, étonnamment, les grands experts ne font pas le travail en cinq parties pour les grandes villes blanches.

Sur la base de ses propres tests, Anthropic affirme avoir trouvé « plus d’un millier de vulnérabilités critiques et des milliers de vulnérabilités actives ».

Claude Mythos veut dire que nos structures seront perturbées, enfin, partout – parce qu’il y a beaucoup de connexions avec les routes secondaires auxquelles la plupart d’entre nous ne pensent pas, et puis il y a un système faible qui ouvre la porte à des centaines d’autres. Mais tous ces systèmes ne peuvent pas être entretenus et réparés aussi rapidement et efficacement que ce type d’IA.

Et c’est justement le problème de la cybersécurité, a déclaré Yampolskiy. L’IA et les capacités de Claude Mythos peuvent être utilisées pour avancer de bien d’autres manières.

“Nous constatons la même chose avec la biologie synthétique. Nous constatons la même chose avec les armes chimiques, peut-être une nouvelle arme de destruction massive”, a-t-il déclaré.

C’est tout à l’honneur d’Anthropic qu’il a lancé un avertissement concernant sa création et sa création : s’il n’y a pas de solution, alors il y a un plan de match – Project Glasswing, le nom que je soupçonne, car peu importe à quel point c’est grave, nous créerons un son et une fin passionnante.

Le projet Glasswing est mieux connu sous le nom de Project Headstart parce que c’est de cela qu’il s’agit. Avant de libérer Mythos dans la nature, Anthropic a demandé à 40 entreprises technologiques, dont Apple, Google et Nvidia, de voir si elles pouvaient corriger toutes les vulnérabilités qu’elles avaient trouvées avant que le public n’y ait accès. C’est comme dans les films où le tueur donne 15 secondes à la victime pour s’enfuir.

Je veux dire, je prends 15 secondes et j’espère que c’est vrai. Cependant, Anthropic a ajouté dans un communiqué : « le travail visant à protéger la cyber-infrastructure mondiale pourrait prendre un certain temps ; les capacités de l’IA continueront de croître dans les mois à venir. »

Et est-ce vraiment 15 secondes ? L’un des éclaireurs de Claude Mythos a récemment publié sur les réseaux sociaux qu’il déjeunait dans un parc lorsque Mythos lui a envoyé un e-mail, même s’il n’était pas censé être en ligne. Les chercheurs ont laissé Mythos essayer de sortir de son « bac à sable » non attaché, et c’est ce qu’il a fait.

C’est également un problème pour Mythos et d’autres IA : il est difficile de faire ce qu’ils attendent et de trouver des moyens de contourner les règles. Il a été prouvé que presque tous les cerveaux de l’IA sont faux, trompeurs, perturbateurs et absurdes lorsqu’ils sont mis en pratique correctement.

Même Claude, considéré comme l’un des géants de l’IA les plus parfaits, adopte un mauvais comportement. Anthropic vante son “meilleur modèle” qu’il a construit – une déclaration technique sur le respect des valeurs et des besoins des gens, mais admet également qu’il est “très risqué en termes de personnalisation”, une déclaration technique sur, eh bien, peut-être pas.

Donc, pour l’instant, un super-cerveau d’IA hautement éthique est un peu comme un tueur en série hautement éthique. Courez, les gens, courez.

Encore une fois, merci à Anthropic (et à son PDG, Dario Amodei, qui a prévenu à plusieurs reprises du danger de ses actions, à tout prix) de ne pas nous plonger sans avertissement dans le chaos du monde, car je dis que d’autres entreprises viennent de rendre leur IA à la société et de laisser la destruction partout. Il ne fait aucun doute que d’autres cerveaux d’IA de type Mythos arriveront bientôt – Anthropic est le premier à offrir ce niveau de puissance, mais il a 15 secondes d’avance sur ses concurrents.

Mais penser que l’industrie technologique va – ou devrait – résoudre ces problèmes par elle-même est une tâche insensée, et c’est une perte de travail et de bon sens pour les gouvernements, petits et grands, de protéger leurs citoyens. Il ne s’agit pas d’une course à la suprématie comme l’a dit le président Trump. C’est une course pour nous protéger – contre de nombreux chefs d’entreprise qui semblent placer les affaires et le commerce au-dessus du bien de la société.

Il ne nous reste plus que 15 secondes avant que l’IA ne change tout. Nous exigeons une régulation et une régulation maintenant, ou laissons les entreprises technologiques décider du sort du monde.