- A AMD pretende lançar o MI500 em 2027, enquanto a Nvidia prepara o Vera-Rubin um ano antes

- CES 2026 mostra lacuna cada vez maior entre os cronogramas do acelerador de IA da AMD e da Nvidia

- AMD expande portfólio de IA enquanto falta um ano para hardware de próxima geração

Na CES 2026, a AMD discutiu seus planos de hardware de IA de curto e longo prazo, incluindo uma prévia dos aceleradores Instinct MI500 Series que chegarão em 2027.

A empresa aproveitou o show para apresentar o Helios, uma plataforma em escala de rack construída em torno da GPU Instinct MI455X e da CPU EPYC Venice. Helios está posicionado como um modelo para infraestrutura de IA em grande escala, em vez de um produto de transporte.

A AMD também apresentou o Instinct MI440X, um novo acelerador voltado para implantações empresariais locais, projetado para cargas de trabalho de treinamento, ajuste e inferência em sistemas existentes de oito GPUs.

Nvidia Vera-Rubin também está a caminho

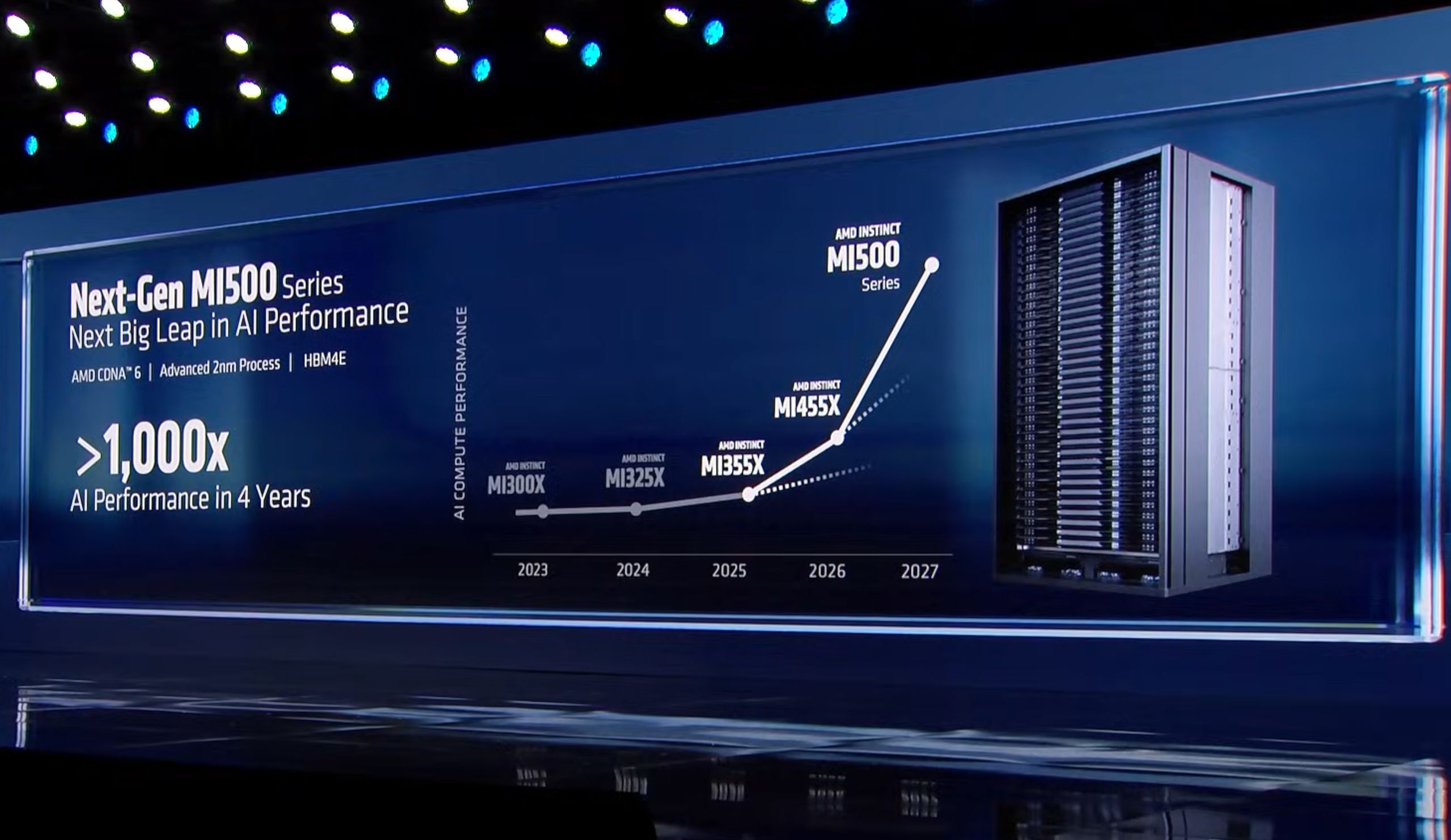

Mais interessante para muitos observadores da indústria, entretanto, é o que vem a seguir. A AMD disse que a série Instinct MI500 está programada para ser lançada em 2027 e oferecerá um grande salto no desempenho de IA em comparação com a geração MI300X.

Espera-se que o MI500 use a arquitetura CDNA 6 da AMD, processo de 2 nm e memória HBM4E.

A AMD diz que o design está no caminho certo para aumentar o desempenho da IA em 1.000 vezes em relação ao MI300X, embora ainda esteja muito longe, nenhum benchmark específico foi compartilhado.

Por mais emocionante que isso possa ser, o momento é inconveniente para a AMD, já que a Nvidia se prepara para lançar sua plataforma Vera-Rubin ainda este ano.

Na CES 2026, a Nvidia também detalhou a substituição dos designs em escala de rack Grace-Blackwell – a plataforma Vera-Rubin é construída a partir de seis novos chips projetados para funcionar como um sistema único em escala de rack.

Isso inclui CPU Vera, GPU Rubin, switch NVLink 6, ConnectX-9 SuperNIC, BlueField-4 DPU e switch Ethernet Spectrum-6.

Na configuração NVL72, o sistema combina 72 GPUs Rubin e 36 CPUs Vera para funcionar como um sistema de memória compartilhada conectado via NVSwitch e NVLink fabric.

A Nvidia afirma que os sistemas Vera-Rubin NVL72 reduzem o custo de inferência por token em 10x para modelos de mistura especializados e reduzem o número de GPUs necessárias para treinamento em 4x.

As GPUs Rubin usam a pilha de memória HBM4 e incluem um novo Transformer Engine com compressão adaptativa suportada por hardware que visa melhorar a eficiência na inferência e no treinamento sem comprometer a precisão do modelo.

Os sistemas baseados em Rubin estarão disponíveis para parceiros no segundo semestre de 2026, incluindo sistemas em escala de rack NVL72 e configurações HGX NVL8 menores, com implantações planejadas de provedores de nuvem, operadores de infraestrutura de IA e fornecedores de sistemas.

Quando a série Instinct MI500 da AMD chegar em 2027, espera-se que a plataforma Vera-Rubin da Nvidia esteja disponível em parceiros e seja usada em escala.

TechRadar cobrirá este ano CESe trarei a você todos os grandes anúncios conforme eles acontecem. Vá até nós Notícias da CES 2026 página para as últimas histórias e nossos veredictos práticos sobre tudo, desde TVs sem fio e telas dobráveis a novos telefones, laptops, dispositivos domésticos inteligentes e o que há de mais moderno em IA. Você também pode nos fazer uma pergunta sobre o show Perguntas e respostas ao vivo da CES 2026 e faremos o nosso melhor para responder.

E não se esqueça siga-nos no TikTok e WhatsApp Para o último show da CES!