- O Raspberry Pi AI HAT+ 2 permite que o Raspberry Pi 5 execute LLMs localmente

- O acelerador Hailo-10H fornece 40 TOPS de poder de inferência INT4

- A interface PCIe permite comunicação de alta largura de banda entre a placa e o Raspberry Pi 5

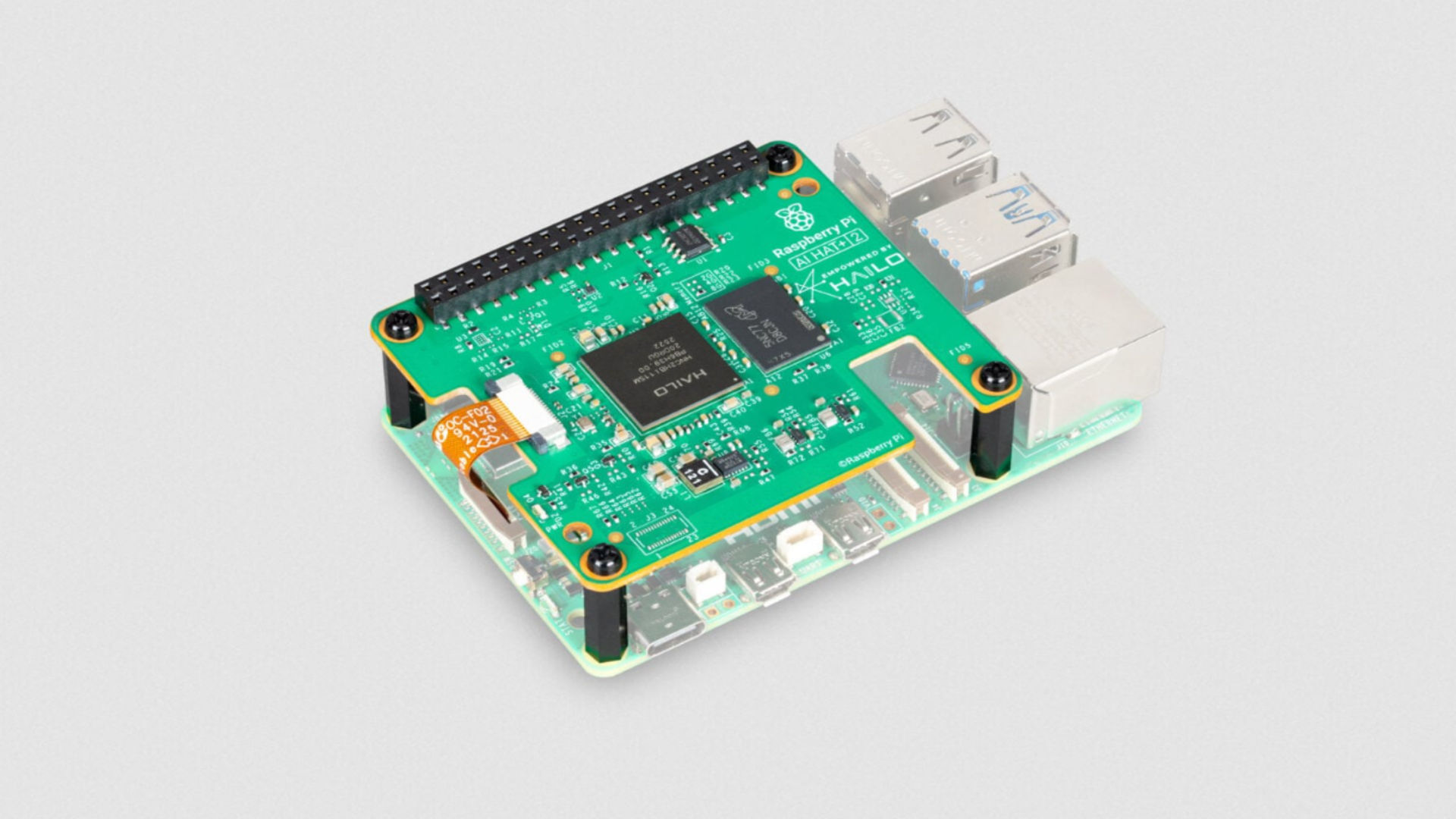

Raspberry Pi expandiu suas ambições de computação de ponta com o lançamento do AI HAT+ 2, um complemento projetado para trazer cargas de trabalho de criação de IA para o Raspberry Pi 5.

O hardware AI HAT anterior concentrava-se quase inteiramente na aceleração da visão computacional, lidando com tarefas como detecção de objetos e segmentação de cena.

A nova estrutura expande esse escopo ao oferecer suporte a grandes modelos de linguagem e modelos de linguagem visual que são executados localmente, sem depender de infraestrutura em nuvem ou de acesso persistente à rede.

Mudanças de hardware que permitem modelos de idioma local

No centro da atualização está o acelerador de rede neural Hailo-10H, que oferece 40TOPS de desempenho de inferência INT4.

Ao contrário de seu antecessor, o AI HAT+ 2 possui 8 GB de memória dedicada, permitindo que o modelo maior rode no host Raspberry Pi sem consumir RAM do sistema.

Essa mudança permite que LLMs e VLMs sejam executados diretamente no dispositivo e mantenham baixa latência e dados locais, o que é um requisito fundamental em muitas implantações de borda.

Usando a distribuição Raspberry Pi padrão, os usuários podem instalar modelos suportados e acessá-los por meio de interfaces familiares, como ferramentas de bate-papo baseadas em navegador.

O AI HAT+ 2 se conecta ao Raspberry Pi 5 através do cabeçalho GPIO e depende da interface PCIe do sistema para transferência de dados, o que exclui compatibilidade com o Raspberry Pi 4.

Essa conexão suporta transferência de dados de alta largura de banda entre o acelerador e o host, o que é essencial para mover entradas, saídas de modelos e dados de câmera com eficiência.

As demonstrações incluem respostas a perguntas baseadas em texto com Qwen2, geração de código usando Qwen2.5-Coder, tarefas básicas de tradução e descrições de cenas visualizadas em imagens de câmeras ao vivo.

Essas cargas de trabalho dependem de ferramentas de IA empacotadas para funcionar na pilha de software Pi, incluindo back-ends em contêineres e servidores de inferência locais.

Todo o processamento ocorre no dispositivo, sem recursos computacionais externos.

Os modelos suportados têm até um milhão e meio de parâmetros, o que é muito maior do que os sistemas baseados em nuvem que operam em escalas muito maiores.

Esses LLMs menores têm como alvo áreas limitadas de memória e poder, em vez de amplo conhecimento de uso geral.

Para superar essa limitação, o AI HAT+ 2 oferece suporte a métodos de ajuste, como adaptação de baixo nível, que permite aos desenvolvedores personalizar modelos para tarefas restritas, mantendo a maioria dos parâmetros inalterados.

Os modelos visuais podem ser reciclados usando conjuntos de dados específicos de aplicativos por meio do conjunto de ferramentas da Hailo.

O AI HAT + 2 está disponível por US$ 130, colocando-o acima dos acessórios focados na visão, ao mesmo tempo que oferece velocidade semelhante à visão do PC.

Para cargas de trabalho que se concentram exclusivamente no processamento de imagens, a atualização oferece ganhos limitados, pois seu apelo é baseado na execução local de LLM e em aplicativos sensíveis à privacidade.

Em termos práticos, o hardware mostra que a IA criativa no hardware Raspberry Pi agora é viável, embora a largura de banda de memória limitada e os tamanhos pequenos dos modelos continuem sendo problemas.

Siga o TechRadar no Google Notícias e adicione-nos como sua fonte padrão para receber notícias, opiniões e opiniões de nossos especialistas em feeds. Certifique-se de clicar no botão Continuar!

E é claro que você também pode Siga o TechRadar no TikTok para receber notícias, análises, unboxings de vídeos e receber atualizações regulares nossas WhatsApp também