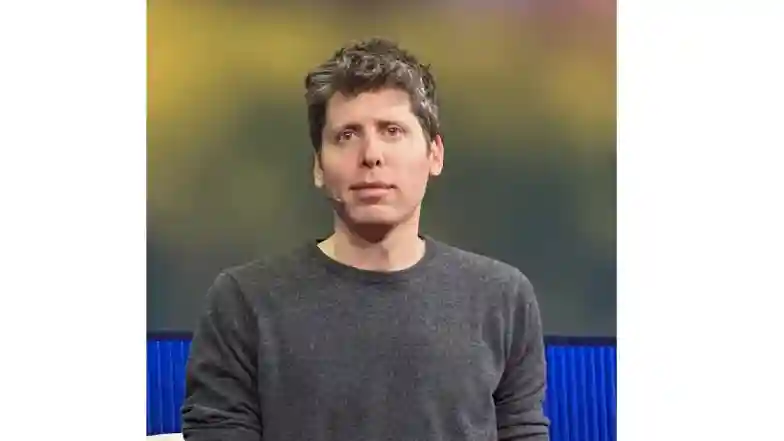

Mumbai, 30 de dezembro: O CEO da OpenAI, Sam Altman, anunciou a busca por um “diretor de reserva”, um cargo de gerenciamento sênior projetado para proteger os modelos de IA cada vez mais poderosos da empresa. Esta função oferece um salário base de US$ 555.000 (aprox. INR 4,6 a 5 milhões de INR) mais capital próprio.

Altman, que anunciou a vaga nas redes sociais, foi sincero sobre as exigências do cargo, descrevendo-o como um “trabalho estressante”, onde o candidato selecionado “pulará no fundo do poço quase imediatamente”.

Gerente de preparação na OpenAI: o que o trabalho envolve

O Head of Readiness liderará a equipe de Sistemas de Segurança da OpenAI, com foco na estratégia técnica e execução do “Readiness Framework” da empresa. Esta estrutura é um modelo de como a OpenAI monitora e se prepara para “capacidades de fronteira”, recursos avançados de IA que podem introduzir novos riscos de danos graves.

A função envolve a construção de avaliações de capacidade e modelos de ameaças para identificar perigos potenciais antes que os modelos sejam divulgados ao público. De acordo com a descrição do cargo, o gestor supervisionará um “sistema de segurança coerente, rigoroso e operacionalmente escalonável”, garantindo que as salvaguardas sejam tecnicamente sólidas e eficazes contra ameaças em evolução.

Segurança cibernética e saúde mental

O impulso às contratações ocorre em um momento crítico, quando os modelos de IA estão passando de simples chatbots para agentes autônomos. Altman destacou duas áreas de preocupação crescente em particular: segurança cibernética e saúde mental.

Altman observou que os modelos estão se tornando tão adeptos da segurança de computadores que estão começando a identificar vulnerabilidades críticas de software. Dito isto, Altman reconheceu que a indústria em 2025 teve uma “visão geral” de como os modelos avançados podem afetar a saúde mental dos utilizadores. Estas preocupações surgem na sequência de vários relatórios e ações judiciais de grande repercussão, alegando que as interações com chatbots de IA contribuíram para o sofrimento emocional e, em casos trágicos, para a automutilação.

A criação desta função segue um período de desgaste significativo nos departamentos de segurança da OpenAI. A liderança anterior em preparação, incluindo Aleksandar Madry, mudou para outras áreas de foco ou deixou totalmente a empresa durante o ano passado.

Analistas da indústria sugerem que, ao adicionar um salário tão elevado ao cargo, a OpenAI está a sinalizar um compromisso com a segurança numa altura em que os críticos argumentam que a pressão comercial para lançar produtos muitas vezes supera a cautela ética. A função foi projetada para fornecer “julgamento técnico” que pode impactar diretamente ou até mesmo impedir o lançamento de um produto se os padrões de segurança não forem atendidos.

Qualificações e expectativas para a função de OpenAI Readiness Manager

A OpenAI procura candidatos com profundo conhecimento técnico em aprendizado de máquina, segurança cibernética ou biossegurança. Embora nenhum diploma formal seja estritamente exigido, a empresa enfatiza a necessidade de “comunicação nítida” e a capacidade de tomar decisões de alto risco sob incerteza.

O Gerente de Preparação liderará uma equipe de pesquisa pequena e de alto impacto, colaborando com engenheiros, especialistas em políticas e parceiros externos. O objectivo é garantir que, à medida que os sistemas de IA se tornam mais capazes de auto-aperfeiçoamento e de acção autónoma, as salvaguardas que os regem permanecem suficientemente fortes para evitar resultados catastróficos.

(A história acima apareceu pela primeira vez em LatestLY em 30 de dezembro de 2025 às 18h32 IST. Para mais notícias e atualizações sobre política, mundo, esportes, entretenimento e estilo de vida, acesse nosso site Latestly.com).