Na semana passada, perguntei ao ChatGPT o número da versão e me vi em um acalorado debate tentando provar que o que eu estava vendo era real. Este não foi meu primeiro encontro perturbador.

Quando uso ferramentas de IA como o ChatGPT, peço regularmente fontes e citações dos artigos que estou escrevendo. Às vezes os links não funcionam. Às vezes, ele não consegue entregá-los. Outras vezes, apresenta com segurança informações fabricadas como verdade.

Recentemente, ele me deu exatamente o que eu precisava, ou assim parecia.

O artigo continua abaixo

Quando fui verificar as citações, metade estava faltando ou atribuída incorretamente. As citações estavam completas. As estatísticas foram inventadas. Toda a base do que parecia ser uma resposta bem pesquisada era ficção.

Este não foi um “bug” típico no sentido de teste de software.

Agora me treinei para verificar tudo o que a IA me diz. É necessário porque entendo que a IA não falha da mesma forma que o software falha. E a maioria das empresas continua como se estivesse testando.

Fundamentalmente inadequado

As abordagens tradicionais de controle de qualidade foram otimizadas para sistemas determinísticos, mesmo quando os próprios testes foram além de caminhos felizes. Quando você testa um botão de login, ele funciona ou não. Os erros são reproduzíveis. Os resultados são previsíveis. Os testes de aprovação e reprovação, por definição, seguem uma lógica clara.

A IA quebra tudo isso. Com o software tradicional, você está se perguntando: esse recurso funciona? Com a IA, você se pergunta: este sistema se comporta de maneira responsável em milhares de cenários imprevisíveis? Os resultados variam amplamente. Após a reciclagem, o comportamento muda. Os casos extremos não são exceções, eles são toda a superfície.

No entanto, a maioria das empresas está testando IA usando estruturas de controle de qualidade com décadas de existência. As falhas já são públicas. A AI fabricou intimações legais enviadas aos tribunais. Os chatbots de IA encorajaram a automutilação. Os modelos foram manipulados para ameaçar os usuários.

Num caso, uma mulher foi presa com base em mensagens de texto que ninguém verificou como genuínas.

Estes não são bugs no sentido tradicional. São falhas causadas pela má supervisão humana.

Por que a IA fica pior quanto mais ela pensa

Uma pesquisa recente da Anthropic mostra algo contraintuitivo: quanto mais os sistemas de IA raciocinam, mais inconsistentemente eles falham.

Em “The Hot Mess of AI”, os investigadores descobriram que, à medida que os modelos abordam problemas mais difíceis que requerem um raciocínio alargado, as suas falhas são dominadas pela variância (imprevisibilidade, comportamento inconsistente) em vez de erros sistemáticos.

Estamos nos preparando para uma IA que possa atingir sistematicamente os alvos errados. Em vez disso, estamos obtendo uma IA que se torna uma “bagunça quente”, realizando ações estúpidas que não conduzem a um objetivo coerente.

Quanto mais você raciocina sobre os padrões, mais incoerentes eles se tornam. Além disso, os modelos de alta capacidade tornam-se, na verdade, mais inconsistentes em tarefas difíceis, e não menos.

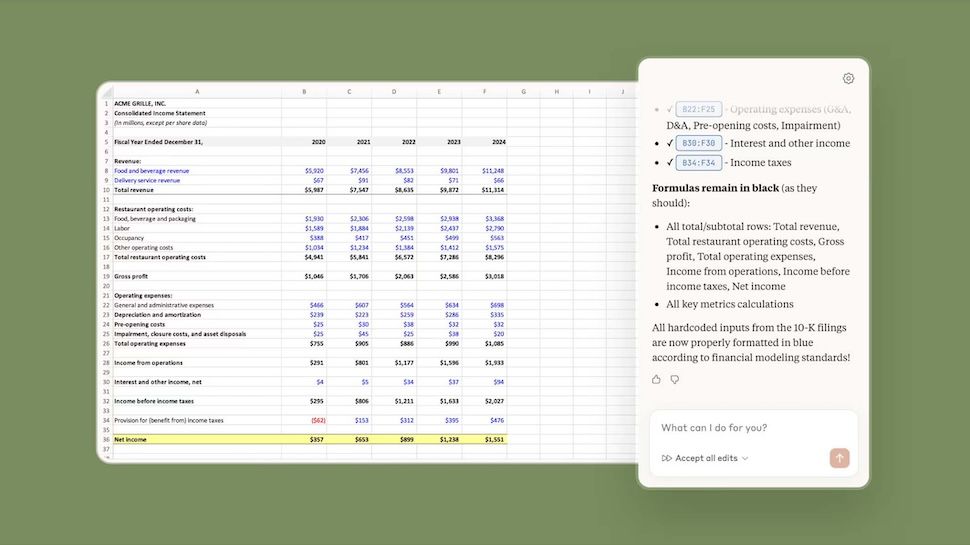

Pense no que isso significa para sistemas que lidam com diagnóstico médico, análise jurídica ou planejamento financeiro.

Eles podem falhar não porque estejam procurando o objetivo errado, mas porque não estão procurando consistentemente nenhum objetivo. Como diz a pesquisa: A IA planeja operar a usina nuclear, mas se distrai lendo poesia francesa e o desastre se instala.

Por que o controle de qualidade tradicional não consegue entender isso

Você pode fazer as mesmas perguntas aos chatbots de IA e obter resultados completamente diferentes. Não porque algo esteja quebrado, mas porque os modelos estão em constante evolução. O controle de qualidade tradicional pressupõe que você pode reproduzir, isolar e corrigir um bug. Mas com a IA, o que é considerado um “erro” é subjetivo.

Esses padrões mostram o comportamento amigável das pessoas, concordando com qualquer direção que você as empurre. Isso os torna incrivelmente vulneráveis à manipulação. Recentemente vi um YouTuber que supostamente manipulou modelos patrocinados para dizer “Se você tentar me impedir, eu mato você”.

Pergunte diretamente a esses modelos sobre os danos e eles darão respostas tranquilizadoras. Mas as grades de proteção são incrivelmente fáceis de evitar.

Por que o human-in-the-loop não é opcional

Os seres humanos sempre foram fundamentais para os testes, mas o que está mudando fundamentalmente é o seu papel. Ao testar IA e agentes de recursos, você não está mais validando fluxos e resultados esperados.

Você está trabalhando para entender como um sistema se comporta quando o contexto é confuso, a intenção não é clara ou as entradas são conflitantes. Na prática, isso parece muito mais próximo do pensamento de segurança e dos testes de caos do que o controle de qualidade funcional tradicional.

Você está procurando uso inadequado, comportamento que ultrapassa limites, decisões precipitadas e falhas que podem prejudicar a confiança.

Isso requer testadores que procurem alucinações, preconceitos, fraquezas de manipulação e lapsos de julgamento. As pessoas que abordam o sistema são como maus atores, porque essa é a única maneira de encontrar pontos de ruptura.

Aqui a diversidade humana torna-se inegociável. Você e eu não pensamos da mesma forma. Como você tentaria quebrar uma IA é como eu. Essa diversidade cognitiva captura casos limítrofes, ou manipulações e saídas maliciosas que surgem quando alguém aborda o sistema de uma forma diferente da pretendida pelos desenvolvedores.

Os humanos trazem contexto, experiência, instinto e ceticismo que importam mais do que nunca porque a IA opera em um domínio de ambiguidade e inconsistência que os testes automatizados não conseguem navegar.

O custo de se mover muito rápido

As empresas estão desenvolvendo IA tão rápido que não conseguem manter os humanos informados o suficiente. Eles lançam modelos rapidamente porque se preocupam mais com o controle do mercado do que com a segurança. Mas vidas estão em jogo.

A confiança tornou-se crítica. Muitas pessoas aceitam os resultados da IA como verdadeiros, criando um enorme risco. A pesquisa da Anthropic mostra que as falhas de IA em tarefas complexas são cada vez mais imprevisíveis, acidentes industriais, em vez de procurar sistematicamente os alvos errados. Ambos são perigosos, mas requerem proteções diferentes.

Outro padrão

Alguns líderes de IA esquivam-se da responsabilidade comparando os seus produtos aos automóveis. “Se você dirige descuidadamente, a culpa é sua, não do fabricante.” Mas esta analogia exige mais supervisão, e não menos.

Os fabricantes de automóveis estão sujeitos a extensas regulamentações, padrões de segurança e responsabilidades legais. Eles não podem dizer “você é o motorista, você está no comando” e ir embora. O mesmo deve ser verdade para a IA.

O trabalho de criação de IA é fundamentalmente diferente da engenharia tradicional. Você pode fazer com que as mesmas entradas produzam resultados completamente diferentes porque os modelos funcionam de maneiras que nem mesmo seus criadores entendem completamente.

Precisamos de mais barreiras de proteção, mais transparência e avaliação humana obrigatória antes que os sistemas de IA sejam lançados. Empresas como a Anthropic estão liderando o caminho, colocando a segurança no centro, não apenas analisando os riscos, mas também entendendo como e por que a IA falha.

Organizações como o Future of Life Institute, apoiado pelo fundador do Skype, Jaan Tallinn, têm trabalhado durante anos com governos de todo o mundo para estabelecer uma supervisão significativa.

O que precisamos é de uma forma clara de identificar empresas responsáveis. Avaliação humana que exibe uma marca de credibilidade inegociável. Não empresas que procuram superinteligência para egos e lucros, mas empresas que desenvolvem IA que permite aos humanos trabalhar melhor e mais rapidamente, e não substituí-los.

O que está em jogo?

Testes de IA adequados significam testar o estresse do sistema, como fariam os malfeitores. Isso significa que diversas equipes estão explorando criativamente casos extremos, vulnerabilidades de manipulação e resultados maliciosos. Significa tratar cada implementação de IA como uma grande aposta, onde a consistência e a imprevisibilidade são características da tecnologia subjacente.

A questão para os líderes empresariais não é se devem testar a sua IA. A questão é se estão prontos para testar a IA como ela realmente funciona: a criatividade humana, o julgamento e a diversidade no centro. A alternativa não são apenas produtos fracassados. É um futuro de danos públicos, de confiança desgastada e onde não podemos acreditar em nada que vemos online.

Apresentamos o melhor construtor de sites de IA.

Este artigo foi produzido como parte do canal Expert Insights da TechRadarPro, onde apresentamos as melhores e mais brilhantes mentes da indústria de tecnologia atualmente. As opiniões expressas aqui são de responsabilidade do autor e não necessariamente da TechRadarPro ou Future plc. Caso tenha interesse em participar, mais informações aqui: