- OpenAI assinou um novo contrato com o Pentágono

- A redação do contrato deixou espaço para que a IA fosse usada para vigilância em massa em casa

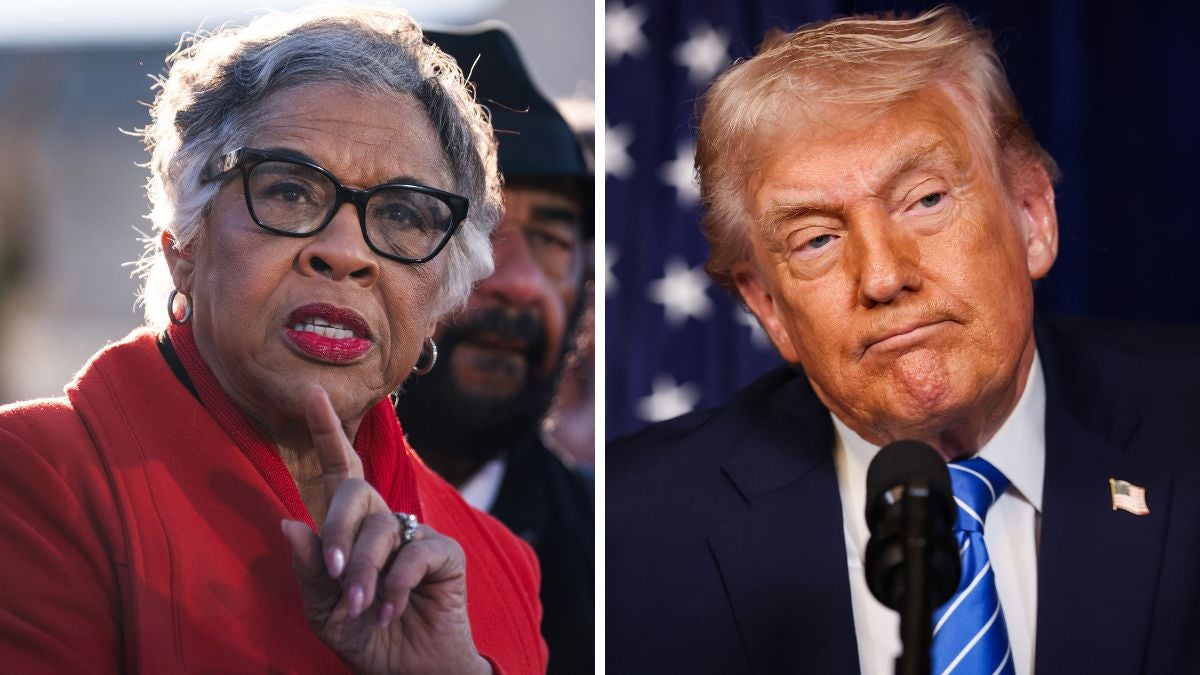

- Sam Altman está sendo criticado por sua posição sobre o assunto

Depois que o secretário de Defesa Pete Hegseth designou a Anthropic como um risco na cadeia de suprimentos e perdeu seu contrato de US$ 200 milhões com o Pentágono, a OpenAI está agora no caminho certo para seu acordo com o Pentágono.

Apesar da cláusula contratual da OpenAI proibir a utilização dos seus modelos de IA pelos militares dos EUA em 2023, vários funcionários da OpenAI revelaram que o Pentágono utilizou anteriormente os seus modelos.

Na altura, o Pentágono tinha um contrato com a Microsoft, que tinha licença para utilizar a tecnologia OpenAI, o que permitia o acesso ao Pentágono através do Azure OpenAI, que não estava sujeito às mesmas políticas.

Com a Anthropic à margem da recusa do Pentágono em usar modelos para sistemas de armas autônomos e vigilância doméstica em massa, o CEO da OpenAI, Sam Altman, está agora questionando o recente contrato da empresa com os militares dos EUA.

Em 2024, a OpenAI suspendeu a proibição geral do uso militar dos seus modelos e mais tarde assinou um contrato com a Anduril, permitindo que os seus modelos fossem implantados para fins de segurança nacional.

Altman deixou claro que apoia a posição da Anthropic para evitar que Claude seja usado para fins nefastos, mas o novo acordo da empresa com os militares dos EUA abriu espaço para esses mesmos fins, disseram fontes familiarizadas com o assunto à Wired.

As regulamentações atuais ficaram atrás dos avanços na IA, apresentando opções para as agências governamentais comprarem informações pessoais sobre cidadãos dos EUA de corretores de dados e, em seguida, usarem modelos de IA para classificar e ordenar as informações para criar perfis de cidadãos altamente detalhados e precisos.

Relativamente ao recente acordo entre a OpenAI e os militares dos EUA, Noam Brown, investigador da OpenAI, afirmou: “Ficou claro no fim de semana que a linguagem original do acordo OpenAI/DoW deixou questões legítimas sem resposta, particularmente sobre algumas das novas formas pelas quais a IA poderia permitir a vigilância legal.”

Brown continuou: “A linguagem foi atualizada para resolver isso, mas acredito que o mundo não deveria depender de laboratórios de IA ou agências de inteligência para sua segurança e proteção”.

Sarah Shoker, ex-chefe da equipe de geopolítica da OpenAI, disse: “Os maiores perdedores em tudo isso são as pessoas comuns e os civis em zonas de conflito. Nossa capacidade de compreender os efeitos da IA militar na guerra é e será severamente prejudicada por camadas de opacidade causadas pelo design técnico e pela política.

A melhor proteção contra roubo de identidade para todos os orçamentos