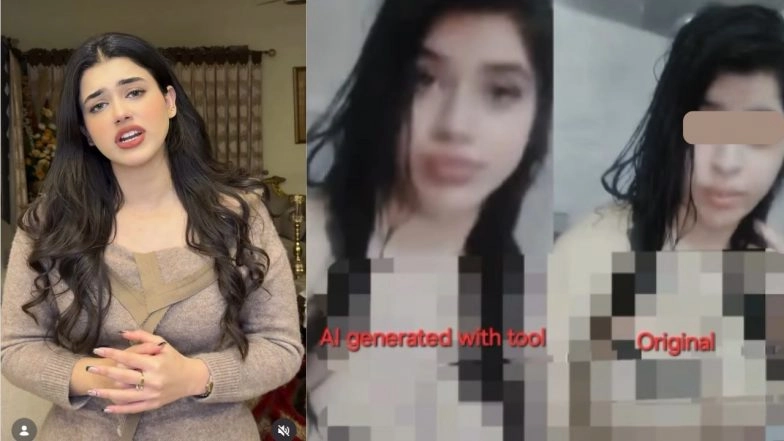

Em janeiro de 2026, a internet foi inundada com pesquisas por um novo “vídeo vazado de 4 minutos e 47 segundos” da influenciadora paquistanesa Alina Amir. Poucos dias depois, a própria Alina apareceu no Instagram, não para se desculpar, mas para mostrar em comparação como o vídeo era um AI Deepfake, uma fabricação digital criada pelo transplante de seu rosto no corpo de outra mulher. Alina Amir expõe ‘link de vídeo vazado’ viral como um AI Deepfake.

Alina não está sozinha e é nova. Ela se junta a uma lista crescente de vítimas, incluindo Fatima Jatoi (Paquistão), Payal Gaming (Índia) e Arohi Mim (Bangladesh), que foram alvo de campanhas idênticas apenas nas primeiras semanas do ano. Vídeos virais vazados em 2026: Alina Amir, Fatima Jatoi, Payal Gaming contra-atacam; Arohi Mim e Casar Umair Silencioso.

Alina Amir fala sobre o vazamento do vídeo viral Deepfake

Por que isso está acontecendo agora? A resposta está na convergência de tecnologia de baixo custo, estratégias agressivas de monetização e na nova “economia paralela” do clickbait.

1. O lado negro da tecnologia: ‘Deepfake-as-a-Service’ (DaaS)

O principal fator por trás do aumento do vazamento é a acessibilidade. Nos anos anteriores, a criação de um deepfake convincente exigia habilidades de codificação de ponta e GPUs poderosas. Em 2026, é um serviço barato.

-

Acessibilidade: As empresas de segurança cibernética relatam uma grande explosão de plataformas “Deepfake-as-a-Service” (DaaS). São sites fáceis de usar ou bots do Telegram onde qualquer pessoa pode enviar uma única foto de um alvo (como Alina Amir ou um colega de classe) e pagar alguns dólares para que ela seja “removida” ou substituída por um vídeo adulto.

-

Velocidade e qualidade: Novas Redes Adversariais Generativas (GANs) e ferramentas de síntese em tempo real tornaram esses vídeos mais difíceis de detectar. Eles não tremem mais ou ficam borrados de forma tão perceptível como em 2023. Essa barreira de entrada reduzida significa que todo troll da Internet é agora um potencial produtor de conteúdo “vazado”.

2. Economia: aplicativos de apostas ‘Link Bait’ e Nexus

Talvez a revelação mais surpreendente seja que muitos destes “vazamentos” não são feitos por vingança ou luxúria; eles são feitos para marketing.

-

Estratégia de aplicação de apostas: O principal padrão observado no Sul da Ásia envolve o uso de deepfakes para direcionar tráfego para aplicativos de apostas ilegais (por exemplo, “1Win” ou “Aviator”). Os golpistas criam um frenesi viral em torno de um “vídeo vazado” de uma celebridade (como Virat Kohli ou Alina Amir).

-

Mecanismo:

-

Gancho: Os bots inundam o X (Twitter) e o Telegram com postagens: “Link de vídeo viral completo de Alina Amir.”

-

Trocar: Quando os usuários clicam no link, eles não abrem o vídeo, mas são redirecionados para baixar um aplicativo de apostas ou “player de vídeo” infectado com malware.

-

Lucro: Os golpistas ganham uma comissão (receita de afiliado) para cada usuário que baixar o aplicativo ou se inscrever. Um “vazamento” é simplesmente uma publicidade gratuita que explora a fama do influenciador.

-

3. Psicologia: Explorando a “lacuna de confiança”

Os golpistas usam o instinto de “ver para crer”.

-

Envenenamento por SEO: Os invasores usam táticas sofisticadas de “envenenamento de SEO”, enviando arquivos PDF falsos contendo esses links para sites confiáveis .edu (universidade) ou .gov servidores. Quando um usuário vê um link em um site de uma universidade confiável, é mais provável que ele clique, presumindo que seja seguro.

-

Sequestro de contexto: Em caso Señoritaos golpistas gravaram um vídeo real dela chorando (sobre um problema pessoal) e publicaram-no novamente como “Reação ao vídeo vazado”. Isso cria uma “lacuna de curiosidade” – os usuários veem lágrimas e assumem um escândalo precisa seja real.

4. Porquê o Sul da Ásia? (Alvo suave)

A Índia, o Paquistão e o Bangladesh tornaram-se o epicentro desta tendência por razões específicas:

-

Alto consumo digital: Estas nações têm algumas das taxas de utilização de dados móveis mais elevadas do mundo, proporcionando uma enorme audiência para conteúdos virais.

-

Estigma cultural: Os golpistas sabem que armas nucleares de “vídeo vazado” (mesmo falsas) destroem reputações nas sociedades conservadoras do sul da Ásia. Contam com que a vítima permaneça em silêncio por vergonha (a “estratégia Arohi Mim”), o que permite que a fraude dure mais tempo sem ser exposta.

-

Danos de gênero: A maioria dos alvos são mulheres. Os relatórios mostram que as aplicações de nudificação e os deepfakes sexualizados estão a ser cada vez mais utilizados para infligir danos de género, enfraquecendo e silenciando as mulheres no espaço digital. Do mistério do ‘vídeo MMS de 19 minutos’ ao caso Smriti Jain Jaisalmer: vazamentos virais e voyeurismo digital.

5. Resposta: Despertar jurídico e social

O caso de Alina Amir marca um ponto de viragem porque ela quebrou o ciclo de silêncio.

-

Procedimento jurídico: Leis como a Lei de TI da Índia e a Lei de Prevenção de Crimes Eletrônicos (PECA) do Paquistão estão agora sendo usadas por influenciadores para registrar FIRs. A reportagem bem-sucedida do Payal Gaming e a subsequente prisão dos suspeitos provam que se trata de crimes rastreáveis. O que Arohi Mim e Fátima Jatoi têm que aprender com Payal Gaming: Combater legalmente links deepfakes de vídeos virais.

-

Responsabilidade da plataforma: O YouTube e outras plataformas estão lançando novas ferramentas de “detecção de similaridade” em 2026 para sinalizar automaticamente conteúdo que simule o rosto ou a voz do criador, com o objetivo de impedir que se espalhe antes que se torne viral.

O vídeo viral de Alina Amir é um aviso!

A ascensão do fenômeno “Vídeo Viral Alina Amir” é um aviso de que a era do “Realismo Deepfake” chegou. É alimentado pela economia paralela, que vê a reputação de uma mulher como um dano colateral para um clique de marketing de afiliados. 7:11, 4:47, 3:24 ou 19 minutos e 34 segundos Armadilhas de vídeo viral: Por que os governos devem agir agora.

À medida que a tecnologia torna mais fácil falsificar a realidade, a única defesa que resta é o ceticismo. Em 2026, se você vir um “link vazado”, provavelmente não há vídeo, apenas um vírus esperando para ser baixado.

(A história acima apareceu pela primeira vez em LatestLY em 28 de janeiro de 2026 às 00:56 IST. Para mais notícias e atualizações sobre política, mundo, esportes, entretenimento e estilo de vida, acesse nosso site Latestly.com).