- Nvidia Rubin DGX SuperPOD oferece 28,8 Exaflops com apenas 576 GPUs

- Cada sistema NVL72 combina 36 CPUs Vera, 72 GPUs Rubin e 18 DPUs

- A taxa de transferência agregada do NVLink atinge 260 TB/s por rack DGX para eficiência

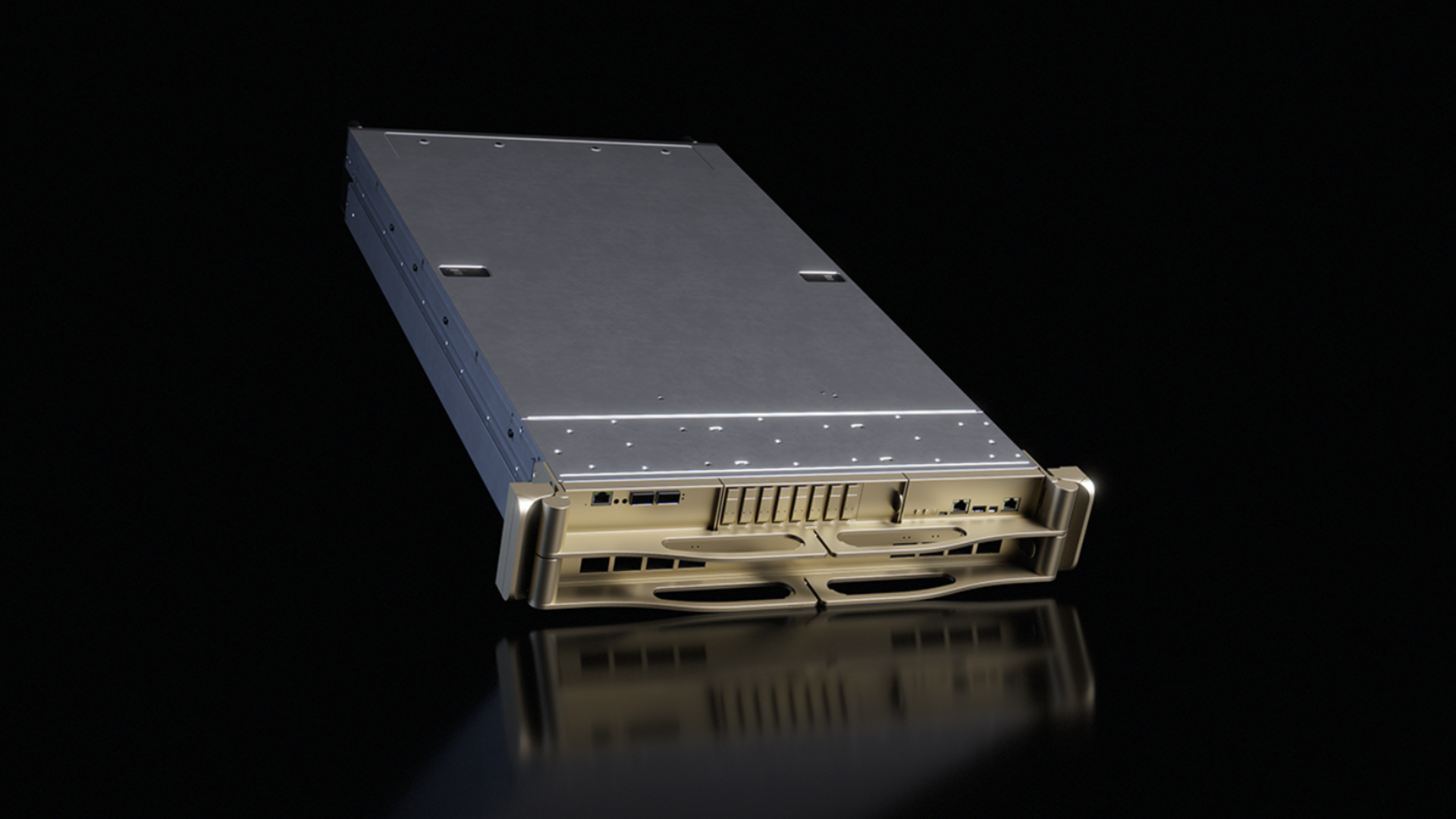

Na CES 2026, a Nvidia revelou a próxima geração DGX SuperPOD alimentada pela plataforma Rubin, um sistema projetado para fornecer computação de IA extrema em racks compactos e integrados.

De acordo com a empresa, o SuperPOD integra vários sistemas Vera Rubin NVL72 ou NVL8 em um único mecanismo de IA coerente, suportando cargas de trabalho em grande escala com complexidade mínima de infraestrutura.

Com módulos refrigerados a líquido, interconexões de alta velocidade e memória integrada, o sistema é voltado para organizações que buscam máximo desempenho de IA e latência reduzida.

Arquitetura de computação baseada em Ruby

Cada sistema DGX Vera Rubin NVL72 inclui 36 CPUs Vera, 72 GPUs Rubin e 18 DPUs BlueField 4, proporcionando um desempenho FP4 combinado de 50 petaflops por sistema.

O desempenho agregado do NVLink atinge 260 TB/s por rack, permitindo que memória completa e espaço de computação operem como um único mecanismo de IA coerente.

As GPUs Rubin incluem o Transformer Engine de terceira geração e compactação acelerada por hardware, permitindo processamento eficiente de inferência e cargas de trabalho de treinamento em escala.

A conectividade é alimentada por switches Ethernet Spectrum-6, Quantum-X800 InfiniBand e SuperNICs ConnectX-9 que suportam transferência determinística de dados de IA de alta velocidade.

O design SuperPOD da Nvidia enfatiza o desempenho extremo da rede, garantindo congestionamento mínimo em grandes clusters de IA.

O Quantum-X800 InfiniBand oferece baixa latência e alto rendimento, enquanto o Spectrum-X Ethernet lida com eficiência com o tráfego de IA leste-oeste.

Cada rack DGX possui 600 TB de memória rápida, armazenamento NVMe e memória de contexto de IA integrada para suportar pipelines de treinamento e inferência.

A plataforma Rubin também integra orquestração avançada de software por meio do Nvidia Mission Control, simplificando as operações de cluster, recuperação automatizada e gerenciamento de infraestrutura para grandes fábricas de IA.

Um DGX SuperPOD com 576 GPUs Rubin pode atingir 28,8 Exaflops de FP4, e sistemas NVL8 individuais oferecem 5,5 vezes mais FLOPS FP4 do que as arquiteturas Blackwell anteriores.

Em comparação, o Atlas 950 SuperPod da Huawei afirma 16 Exaflops por SuperPod FP4, o que significa que atinge maior eficiência por GPU Nvidia e requer menos unidades para atingir níveis extremos de computação.

O cluster DGX baseado em Rubin usa menos nós e gabinetes do que o SuperCluster da Huawei, que pode ser dimensionado para vários petabytes de memória e milhares de NPUs.

Esta densidade de desempenho permite que a Nvidia concorra diretamente com a produção de computação projetada da Huawei, ao mesmo tempo que limita espaço, energia e interconexão.

A plataforma Rubin unifica computação, rede e software de IA em uma única pilha.

O software Nvidia AI Enterprise, os microsserviços NIM e a orquestração de missão crítica criam um ambiente coeso para raciocínio contextual longo, IA agente e implantação de modelo multimodal.

Embora a Huawei dimensione principalmente através da quantidade de hardware, a Nvidia enfatiza a eficiência no nível do rack e controles de software altamente integrados, que reduzem os custos operacionais para cargas de trabalho de IA em escala industrial.

TechRadar cobrirá este ano CESe trarei a você todos os grandes anúncios conforme eles acontecem. Vá até nós Notícias da CES 2026 página para as últimas histórias e nossos veredictos práticos sobre tudo, desde TVs sem fio e telas dobráveis a novos telefones, laptops, dispositivos domésticos inteligentes e o que há de mais moderno em IA. Você também pode nos fazer uma pergunta sobre o show Perguntas e respostas ao vivo da CES 2026 e faremos o nosso melhor para responder.

E não se esqueça siga-nos no TikTok e WhatsApp Para o último show da CES!