São Francisco, 3 de março: A OpenAI está enfrentando uma revolta em massa do consumidor à medida que as desinstalações de seu aplicativo móvel ChatGPT dispararam após uma parceria com o Departamento de Defesa dos EUA, que foi recentemente renomeado como Departamento de Guerra. A reação afetou significativamente a posição da empresa no mercado, com milhões de usuários expressando preocupações sobre o uso ético da inteligência artificial em operações militares.

As desinstalações de aplicativos ChatGPT nos EUA aumentaram 295% no sábado, 28 de fevereiro, de acordo com a empresa de pesquisa de mercado Sensor Tower. Esse aumento é quase 33 vezes maior do que a taxa diária típica de desinstalação de aplicativos de 9%. Ao mesmo tempo, os novos downloads caíram 13% à medida que as notícias do acordo militar confidencial se espalhavam nas redes sociais. O CEO da Anthropic, Dario Amodei, desafia o ultimato do Pentágono sobre o uso ético da inteligência artificial em meio a ameaças arriscadas à cadeia de suprimentos.

Claude, da Anthropic, se torna o número um à medida que os usuários migram

A polêmica acabou sendo uma grande vitória para a empresa rival Anthropic. Depois de se recusar publicamente a entrar em um acordo semelhante devido a preocupações com vigilância em massa e armas autônomas, o aplicativo Claude da Anthropic saltou para o primeiro lugar na App Store dos EUA. Os downloads de Claude aumentaram 51% no sábado, com alguns relatórios sugerindo que os downloads diários ultrapassaram o ChatGPT pela primeira vez na história.

A postura da Anthropic repercutiu entre os usuários que priorizaram a segurança e a neutralidade digital. A mudança também se refletiu no feedback da app store, onde o ChatGPT viu um salto de 775% nas avaliações de uma estrela no fim de semana. Os críticos focaram particularmente no potencial do modelo de IA ser usado por agências de inteligência como a NSA, apesar das alegações da OpenAI de salvaguardas integradas.

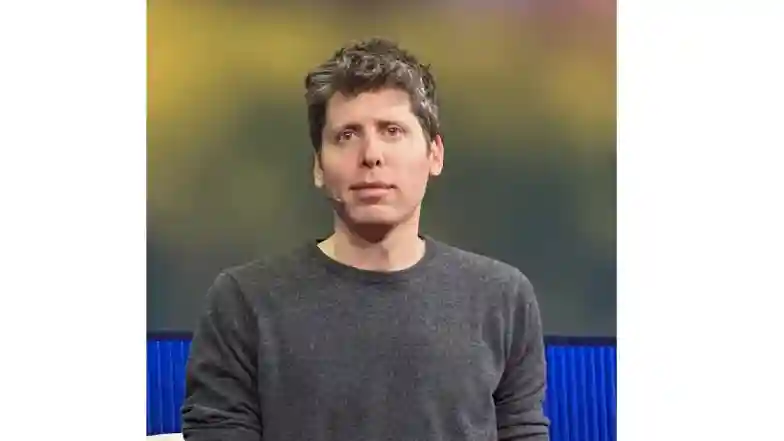

O próprio Altman admite a execução ‘desleixada’ da parceria de defesa

Em resposta ao crescente movimento “Cancelar ChatGPT”, o CEO da OpenAI, Sam Altman, admitiu que o anúncio foi “oportunista e desleixado”. Numa publicação no X, Altman reconheceu que o momento – logo após uma rixa pública entre o Pentágono e a Antrópico – parecia errado e apelou a uma comunicação mais clara sobre os limites do projecto.

Altman esclareceu que o acordo proíbe especificamente o uso da tecnologia OpenAI para vigilância doméstica em massa de cidadãos dos EUA ou para alimentar armas letais totalmente autônomas. Ele disse que a empresa está atualmente mudando a linguagem do contrato para impedir especificamente a Agência de Segurança Nacional (NSA) de usar seus serviços sem um acordo separado e altamente regulamentado.

Preocupações com privacidade de dados e ética militar

O acordo permite que os militares dos EUA implantem modelos avançados da OpenAI em suas redes classificadas como “somente em nuvem”. Embora a OpenAI insista que os especialistas humanos permanecerão “informados” em todas as decisões importantes, grupos de direitos digitais alertaram que os limites entre o apoio em segundo plano e a automatização do campo de batalha estão a tornar-se cada vez mais confusos. A avaliação da OpenAI atingiu US$ 730 bilhões após uma rodada histórica de financiamento de US$ 110 bilhões liderada pela Amazon e Nvidia.

À medida que a indústria se aproxima de um novo ano fiscal, a discrepância entre os contratos governamentais orientados para o lucro e a ética centrada no utilizador está a tornar-se um desafio definidor para os laboratórios de IA. Embora a OpenAI tenha garantido uma avaliação de 730 mil milhões de dólares após uma recente ronda de financiamento de 110 mil milhões de dólares, o êxodo atual sugere que manter a confiança do consumidor pode ser tão crítico quanto a superioridade técnica.

(A história acima apareceu pela primeira vez em LatestLY em 3 de março de 2026 às 14h58 IST. Para mais notícias e atualizações sobre política, mundo, esportes, entretenimento e estilo de vida, acesse nosso site Latestly.com).