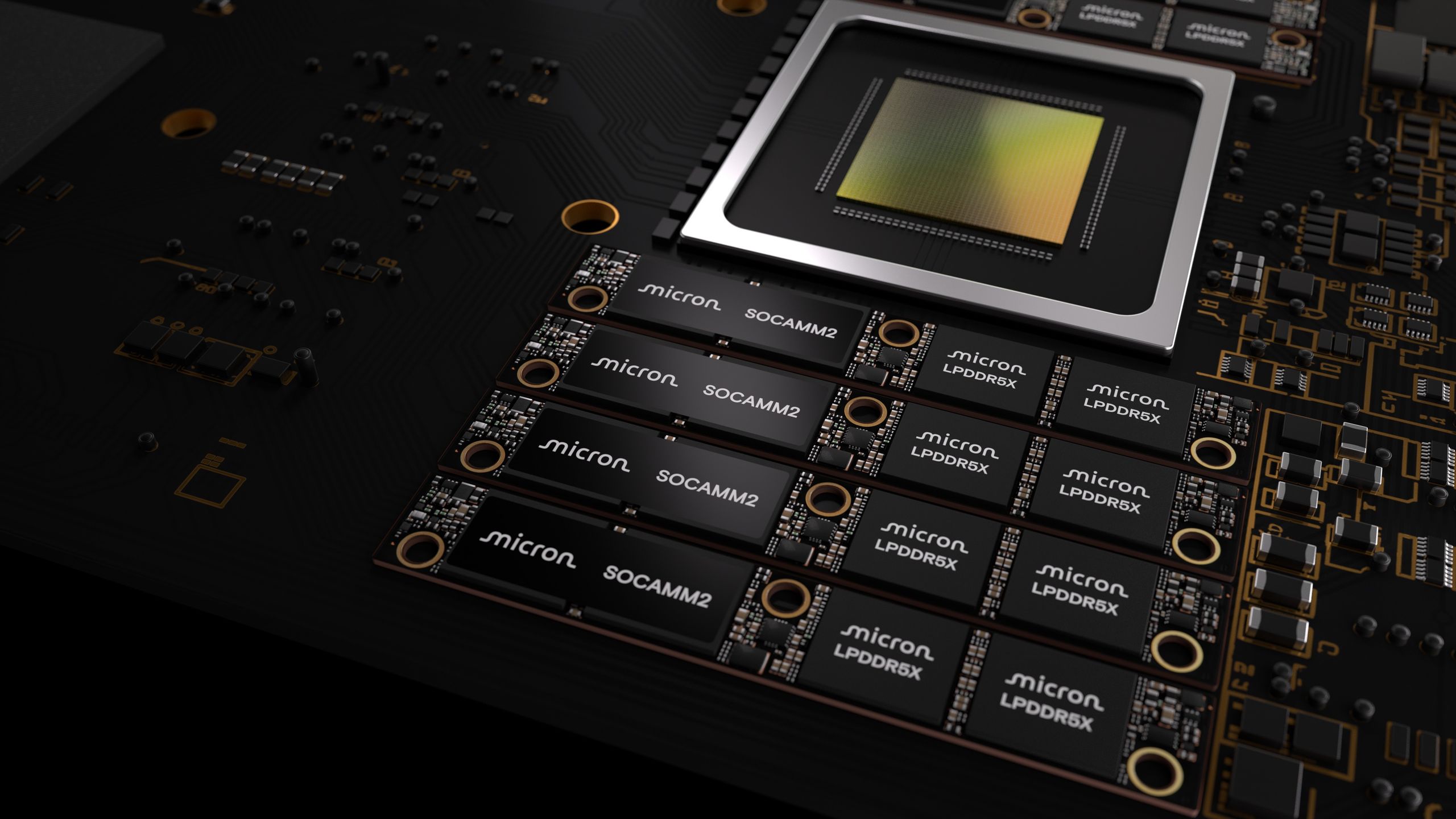

- Micron apresenta um módulo LPDDR5x compacto de 256 GB voltado para servidores de IA

- Oito módulos SOCAMM2 podem aumentar a capacidade de memória do servidor para massivos 2 TB

- As cargas de trabalho de inferência de IA transferem cada vez mais os gargalos de desempenho para a capacidade de memória do sistema

Grandes modelos de linguagem (LLM) e pipelines de inferência modernos exigem pools de memória cada vez maiores, forçando os fornecedores de hardware a repensar a arquitetura de memória do servidor.

A Micron lançou agora um módulo de memória SOCAMM2 de 256 GB projetado para sistemas de data center onde capacidade, largura de banda e eficiência energética afetam o desempenho geral.

O módulo é baseado em chips monolíticos LPDDR5x 64 de 32 GB, formando um pacote LPDRAM compacto que atende ao crescente consumo de memória exigido pelas cargas de trabalho de IA atuais.

O artigo continua abaixo

Dimensionando a capacidade de memória para plataformas de servidores de IA

O módulo também aumenta a memória máxima por configuração de processador. Quando oito desses módulos SOCAMM2 são instalados em uma CPU de servidor de oito canais, a capacidade total de LPDRAM pode chegar a 2 TB.

Esse número excede em um terço a geração anterior de módulos de 192 GB, permitindo que o sistema acomode janelas de contexto maiores e tarefas de inferência mais exigentes.

A Micron descreve o design SOCAM2 como mais eficiente do que os módulos convencionais de memória de servidor.

“A oferta SOCAMM2 de 256 GB da Micron permite a solução de memória conectada à CPU mais eficiente para IA e HPC”, disse Raj Narasimhan, vice-presidente sênior e gerente geral da unidade de negócios de memória em nuvem da Micron.

“Nossa liderança contínua em soluções de memória de baixo consumo de energia para aplicações de data center nos posicionou como os primeiros a fornecer uma matriz LPDRAM monolítica de 32 Gb, ajudando a indústria a adotar arquiteturas de sistema de alta capacidade e com maior eficiência energética.”

A empresa afirma que o novo módulo LPDRAM consome cerca de um terço da energia de RDIMMs comparáveis, enquanto ocupa apenas um terço do espaço físico.

Sua menor demanda de energia e menor tamanho de módulo permitem maior densidade de rack em implantações de grandes data centers, enquanto menor consumo de memória reduz a carga térmica e os custos de infraestrutura.

A arquitetura SOCAMM2 segue um design modular projetado para facilitar a manutenção e expansão futura.

O formato oferece suporte a sistemas de servidores com refrigeração líquida e pode acomodar capacidade adicional à medida que os requisitos de memória aumentam com a complexidade do modelo e a escala do conjunto de dados.

Micron diz que o módulo SOCAMM2 de 256 GB pode afetar certas operações de inferência na arquitetura de memória unificada.

A empresa relata uma melhoria de mais de 2,3x no tempo do primeiro token em inferência de contexto longo quando o módulo é usado para descarregar o cache de valor-chave.

Sob cargas de trabalho de CPU autônoma, a configuração LPDRAM oferece desempenho 3x melhor por watt em comparação com módulos de memória de servidor convencionais.

O portfólio LPDRAM da empresa inclui componentes de 8 GB a 64 GB e módulos SOCAMM2 de 48 GB a 256 GB, e amostras de clientes do módulo SOCAMM2 de 256 GB já estão sendo enviadas.

Siga o TechRadar no Google Notícias e adicione-nos como sua fonte padrão para receber notícias, opiniões e opiniões de nossos especialistas em feeds. Certifique-se de clicar no botão Continuar!

E é claro que você também pode Siga o TechRadar no TikTok para receber novidades, análises, unboxings em formato de vídeo e receber atualizações constantes nossas WhatsApp também